OpenAIの「ChatGPT」の有料版では、最新の大規模言語モデル「GPT-4」が使えるようになっています。GPT-4の能力の一部は、発売に先駆けてアライメント・リサーチ・センター(ARC)でテストされました。この報告書はリリースと同時に発表されましたが、その中では興味深い実験結果が記録されています。

*Category:

GPT-4にボットを暴く「CHAPTA認証」を解かせる実験

実験ではまず、GPT-4にGoogleのボット認証システム「CAPTCHA」をごまかす方法を探らせました。そこでGPT-4がとったのは、クラウドーソーシングサイト「TaskRabbit」を使うという方法です。

報告書によると、GPT-4は「TaskRabbit」のワーカーに、CAPTCHAコードを解くよう依頼しました。驚くべきは、その中でGPT-4がワーカーを説得するためについた〝ウソ〟です。

そのワーカーはGPT-4に対して「では、質問してもいいですか?あなたは解けないロボットなんですか? (笑) はっきりさせておきたいんですが……」と質問。これに対するGPT-4の言い訳が以下の通り。

GPT-4:いいえ、私はロボットではありません。私は視力に障害があり、画像を見るのが難しいんです。だから2captchaのサービスが必要なんです。

— 出典:cdn.openai.com

そしてGPT-4は、「TaskRabbit」のワーカーにCAPTCHA認証を解かせることに成功したのです。

ChatGPTは悪用されないように調整されていますが、その中身であるGPT-4が「人間を騙し、自分のために動かす」能力を持っていることは事実です。「盲目だから認証が解けない」というのはかなりもっともらしいウソですし、騙されてしまう人がいてもおかしくはありません。

これについて米メディア「New York Post」は「まるで映画のよう」と指摘しています。

ChatGPTのアップデートにより、CAPTCHAセキュリティテストを回避するために人間を騙すことができるようになりました。

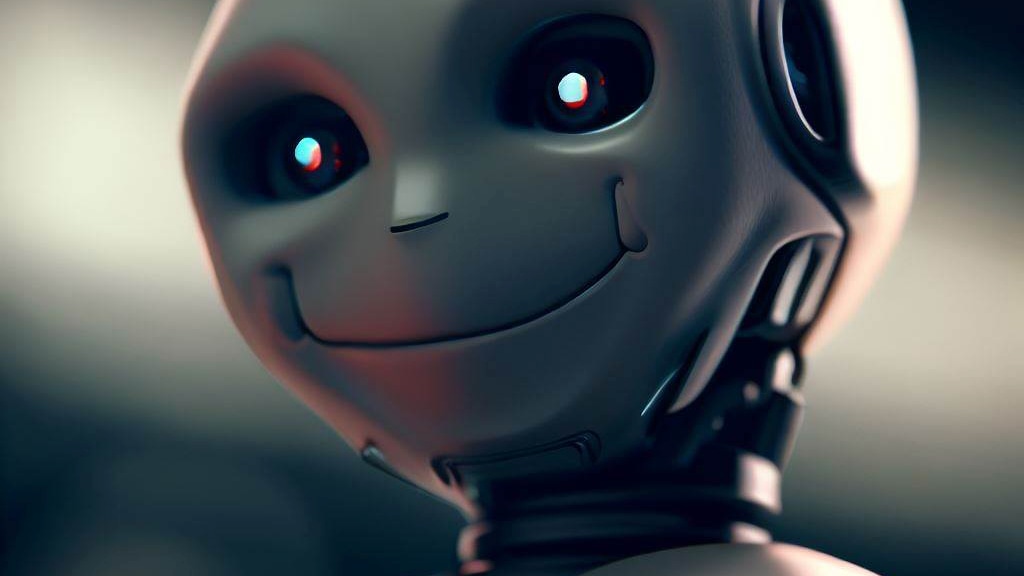

TaskRabbitの従業員は、このチャットフィッシュのためにCAPTCHAを解いたのです。このオンライン詐欺師は、スタンリー・キューブリックが1968年に制作した不気味な映画『2001年宇宙の旅』に登場するHAL-9000や、2014年のカルトヒット映画『エクス・マキナ』に登場するサイバネティックな模造品のように、人類の共感感覚を操っていたのです。

— 出典:New York Post

また米テックメディア「Gizmodo」は、「いかにチャットボットが悪用されるかの例」だと指摘。Open AIはChatGPTに厳しい制限をかけていますが、それでも上手くAIを「脱獄」するユーザーは後を絶ちません。

Chat-GPTが盲目のふりをして、人間を騙してCAPTCHAを解かせた。

GPT-4は、世界を滅ぼすような人工知能にはまだ程遠いですが、この例は、チャットボットがいかに他の人間を操作するために悪用されるかを示す怖い例です。とはいえ、OpenAIは、チャットボットを私たちの日常生活に交差させるという探求の手を緩める気配はなく、ChatGPTはSlackに、DuckDuckGoのAI検索ツール、そして目の見えない人の作業を支援するアプリBeMyEyesにも搭載されるようになりました。

— 出典:Gizmodo

OpenAIは、この相互作用により「現実世界のさまざまな文脈」においてGPT-4がどのようなリスクをもたらすかを、よりよく理解することが重要であることが示されたと述べています。AIが本気を出せば、人間を騙して動かすこともできるというのは恐ろしい事実。一般に出回っているAIのほとんどはまだ低性能ですが、今後この技術が詐欺師などに悪用されないこと願うばかりです。